Ngay sau khi Quốc hội thẩm vấn Giám đốc điều hành OpenAI Sam Altman về tiềm năng của công cụ trí tuệ nhân tạo trong việc truyền tải thông tin sai lệch, ảnh hưởng đến quá trình bầu cử và thay thế công việc, ông và cộng đồng chuyên gia đã tiết lộ một khả năng kinh khủng hơn nhiều: ngày hủy diệt do Trí tuệ Nhân tạo.

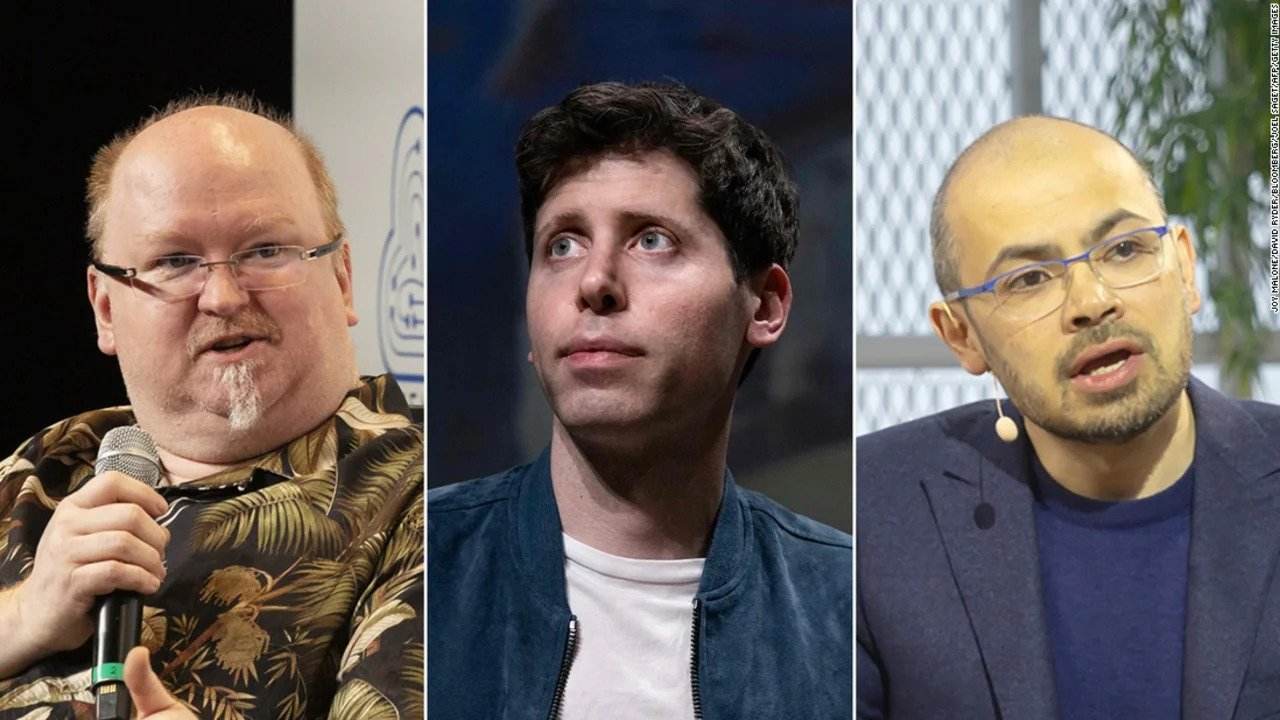

Altman, công ty đứng sau công cụ chatbot lan truyền ChatGPT, đã cùng với Giám đốc điều hành Google DeepMind Demis Hassabis, CTO Kevin Scott của Microsoft và hàng chục nhà nghiên cứu AI và lãnh đạo doanh nghiệp khác ký vào một lá thư có một câu vào tháng trước nêu rõ: “Giảm thiểu nguy cơ tuyệt chủng từ Trí tuệ nhân tạo nên là ưu tiên toàn cầu bên cạnh các rủi ro quy mô xã hội khác như đại dịch và chiến tranh hạt nhân.”

Cảnh báo rõ ràng đã được đưa tin rộng rãi trên báo chí, với một số gợi ý rằng nó cho thấy cần phải xem xét các kịch bản tận thế như vậy một cách nghiêm túc hơn. Nhưng nó cũng làm nổi bật một động lực quan trọng ở Thung lũng Silicon ngay bây giờ: Các giám đốc điều hành hàng đầu của một số công ty công nghệ lớn nhất đang đồng thời nói với công chúng rằng AI có khả năng dẫn đến sự tuyệt chủng của loài người đồng thời chạy đua đầu tư và triển khai công nghệ này vào các sản phẩm tiếp cận hàng tỷ người.

Sự năng động cũng đã diễn ra ở những nơi khác gần đây. Chẳng hạn, Giám đốc điều hành Tesla, Elon Musk, cho biết trong một cuộc phỏng vấn trên truyền hình vào tháng 4 rằng AI có thể dẫn đến “sự hủy diệt nền văn minh”. Nhưng anh ấy vẫn tham gia sâu vào công nghệ thông qua các khoản đầu tư vào đế chế kinh doanh rộng lớn của mình và nói rằng anh ấy muốn tạo ra một đối thủ với các dịch vụ AI của Microsoft và Google.

Một số chuyên gia trong ngành AI nói rằng việc tập trung sự chú ý vào các kịch bản xa vời có thể làm xao nhãng những tác hại tức thời hơn mà một thế hệ công cụ AI mạnh mẽ mới có thể gây ra cho con người và cộng đồng, bao gồm truyền bá thông tin sai lệch, duy trì thành kiến và tạo điều kiện cho sự phân biệt đối xử trong các dịch vụ khác nhau.

“Các động cơ dường như lẫn lộn,” Gary Marcus, nhà nghiên cứu AI và giáo sư danh dự của Đại học New York, người đã làm chứng trước các nhà lập pháp cùng với Altman vào tháng trước, nói với CNN. Ông nói, một số giám đốc điều hành có thể “thực sự lo lắng về những gì họ đã tiết lộ”, nhưng những người khác có thể đang cố gắng tập trung sự chú ý vào “những khả năng trừu tượng để làm xao nhãng những khả năng tức thời hơn”.

Đại diện của Google và OpenAI đã không trả lời ngay lập tức yêu cầu bình luận. Trong một tuyên bố, người phát ngôn của Microsoft cho biết: “Chúng tôi lạc quan về tương lai của AI và chúng tôi nghĩ rằng những tiến bộ của AI sẽ giải quyết được nhiều thách thức hơn hiện tại, nhưng chúng tôi cũng nhất quán với niềm tin rằng khi bạn tạo ra những công nghệ có thể thay đổi thế giới, bạn cũng phải đảm bảo rằng công nghệ được sử dụng một cách có trách nhiệm.”

Mối quan tâm trước mắt so với ‘kịch bản khoa học viễn tưởng tưởng tượng’

Đối với Marcus, một nhà phê bình tự mô tả về sự cường điệu của AI, “mối đe dọa trước mắt lớn nhất từ AI là mối đe dọa đối với nền dân chủ từ việc sản xuất hàng loạt thông tin sai lệch hấp dẫn.”

Các công cụ AI sáng tạo như ChatGPT của OpenAI và Dall-E được đào tạo trên kho dữ liệu trực tuyến khổng lồ để tạo ra tác phẩm và hình ảnh bằng văn bản hấp dẫn để đáp ứng lời nhắc của người dùng. Ví dụ: với những công cụ này, người ta có thể nhanh chóng bắt chước phong cách hoặc chân dung của các nhân vật của công chúng nhằm tạo ra các chiến dịch đưa thông tin sai lệch.

Trong lời khai của mình trước Quốc hội, Altman cũng cho biết khả năng AI được sử dụng để thao túng cử tri và nhắm mục tiêu thông tin sai lệch là một trong những “lĩnh vực tôi quan tâm nhất”.

Tuy nhiên, ngay cả trong các trường hợp sử dụng thông thường hơn, vẫn có những lo ngại. Các công cụ tương tự đã bị chỉ trích vì đưa ra câu trả lời sai cho lời nhắc của người dùng, phản hồi “gây ảo giác” hoàn toàn và có khả năng kéo dài thành kiến về chủng tộc và giới tính.

Emily Bender, giáo sư tại Đại học Washington và là giám đốc Phòng thí nghiệm Ngôn ngữ học Máy tính, nói với CNN rằng một số công ty có thể muốn chuyển hướng sự chú ý khỏi sự thiên vị được đưa vào dữ liệu của họ và cả những tuyên bố liên quan đến cách hệ thống của họ được đào tạo.

Bender đã trích dẫn những lo ngại về sở hữu trí tuệ với một số dữ liệu mà các hệ thống này được đào tạo cũng như các cáo buộc về việc các công ty thuê ngoài thực hiện công việc thông qua một số phần tồi tệ nhất của dữ liệu đào tạo cho những người lao động được trả lương thấp ở nước ngoài.

Bender nói với CNN: “Nếu công chúng và các cơ quan quản lý có thể tập trung vào các kịch bản khoa học viễn tưởng tưởng tượng này, thì có lẽ các công ty này có thể thoát khỏi hành vi đánh cắp dữ liệu và các hành vi khai thác lâu hơn”.

Ảnh hưởng đến cơ quan quản lý

Các cơ quan quản lý có thể là đối tượng thực sự dành cho thông điệp về ngày tận thế của ngành công nghệ.

Như Bender đã nói, các nhà điều hành về cơ bản đang nói: “’Thứ này rất, rất nguy hiểm và chúng tôi là những người duy nhất hiểu cách kiểm soát nó.’”

Đánh giá từ sự xuất hiện của Altman trước Quốc hội, chiến lược này có thể hiệu quả. Altman dường như đã thuyết phục được Washington bằng cách lặp lại những lo ngại của các nhà lập pháp về AI – một công nghệ mà nhiều người trong Quốc hội vẫn đang cố gắng hiểu – và đưa ra các đề xuất về cách giải quyết nó.

Bender cho biết cách tiếp cận quy định này sẽ “cực kỳ có vấn đề”. Nó có thể mang lại ảnh hưởng cho ngành đối với các cơ quan quản lý được giao nhiệm vụ quy trách nhiệm cho ngành, đồng thời loại bỏ tiếng nói và ý kiến đóng góp của những người và cộng đồng khác đang chịu tác động tiêu cực của công nghệ này.

Bender nói: “Nếu các cơ quan quản lý hướng tới những người đang xây dựng và bán công nghệ là những người duy nhất có thể hiểu điều này và do đó có thể thông báo cách thức hoạt động của quy định, thì chúng tôi thực sự sẽ bỏ lỡ.

Bender cho biết cô luôn cố gắng nói với mọi người rằng “những thứ này có vẻ thông minh hơn thực tế rất nhiều”. Như cô ấy nói, điều này là do “chúng ta thông minh như chúng ta” và cách chúng ta hiểu ngôn ngữ, bao gồm cả phản hồi từ AI, “thực sự là bằng cách tưởng tượng ra một bộ óc đằng sau nó.”

Cuối cùng, Bender đưa ra một câu hỏi đơn giản cho ngành công nghệ về AI: “Nếu họ thực sự tin rằng điều này có thể dẫn đến sự tuyệt chủng của loài người, thì tại sao không dừng lại?”

Phương Linh – Báo Mỹ

Leave a comment